https://www.carnot-tsn.fr/wp-content/uploads/2026/01/starting_logo.png

630

970

India Senouci

https://www.carnot-tsn.fr/wp-content/uploads/2021/09/logo-carnot-tsn.png

India Senouci2026-01-12 15:52:432026-01-27 16:01:12[BELLE HISTOIRE] Une plateforme pour tester les performances des nouveaux systèmes télécoms

https://www.carnot-tsn.fr/wp-content/uploads/2026/01/starting_logo.png

630

970

India Senouci

https://www.carnot-tsn.fr/wp-content/uploads/2021/09/logo-carnot-tsn.png

India Senouci2026-01-12 15:52:432026-01-27 16:01:12[BELLE HISTOIRE] Une plateforme pour tester les performances des nouveaux systèmes télécoms[BELLE HISTOIRE] Faciliter la détection du cancer du sein grâce à l’IA

9 mars 2026 • Big Data & IA - Health - Santé numérique

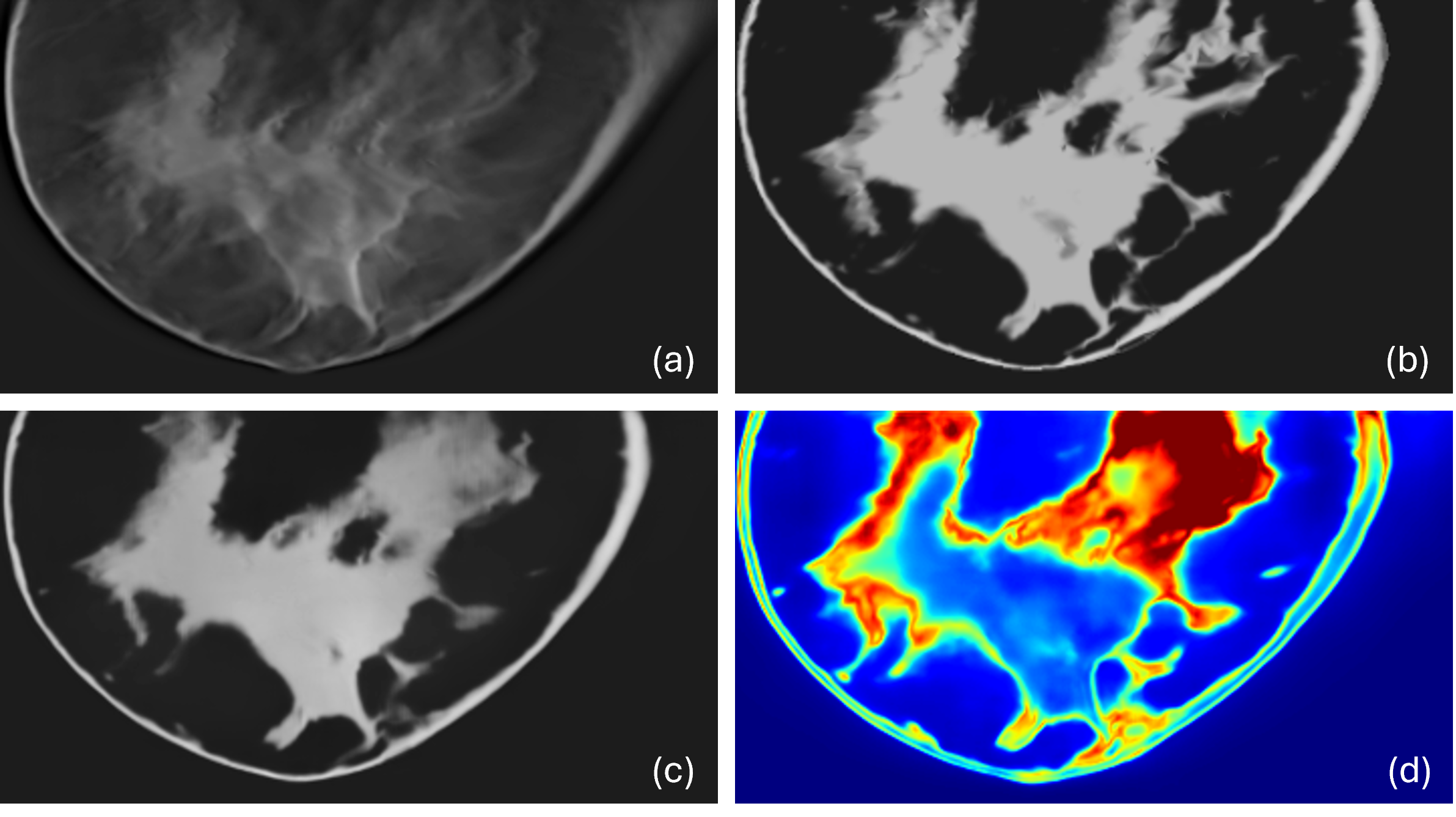

La tomosynthèse du sein, ou mammographie 3D, vise à améliorer le diagnostic précoce du cancer du sein à l’aide d’images 3D plus précises. Néanmoins, celles-ci peuvent comporter des dégradations provenant des contraintes associées à l’examen, pouvant rendre leur contenu plus complexe à interpréter. Des limites qu’Arnaud Quillent a cherché à dépasser grâce au deep learning, dans le cadre d’une thèse CIFRE réunissant l’entreprise GE HealthCare et le LTCI, laboratoire de l’école Télécom Paris, composante de l’institut Carnot TSN.

D’après Santé publique France, le cancer du sein représente la première cause de décès par cancer chez la femme. C’est pourquoi l’État français, dans le cadre d’un programme national de dépistage, recommande à toutes les femmes âgées de 50 à 74 ans de se faire dépister tous les deux ans. Un examen qui consiste généralement en une mammographie 2D : le sein est placé entre une source de rayons X et un détecteur afin d’obtenir une image en niveaux de gris, traduisant la présence de différentes matières – graisse, glande mammaire, ou encore tumeurs.

Tomosynthèse du sein : une meilleure précision mais une qualité d’images limitée

Mais depuis les années 2010, une nouvelle méthode de dépistage a fait son apparition : la mammographie 3D, ou tomosynthèse du sein, une modalité d’imagerie se rapprochant du scanner.

Dans un scanner, le générateur de rayons X et le détecteur tournent à 360° autour de la patiente allongée. Une série de clichés est acquise durant cette rotation, images qui sont par la suite utilisées pour reconstituer un volume 3D de la zone examinée. En s’appuyant sur un principe similaire, la tomosynthèse du sein permet d’obtenir des images plus précises, et donc de faciliter le diagnostic des praticiens. Le recours à cette technique affiche ainsi des résultats prometteurs, en particulier lorsqu’elle est couplée à la mammographie 2D classique.

Cependant, dans le cas de la tomosynthèse, la méthode se heurte à des limites inhérentes à son fonctionnement. « Contrairement à un examen par scanner, il n’est pas possible de tourner à 360° autour de la patiente », constate Arnaud Quillent, ingénieur de recherche en traitement d’images chez GE HealthCare. « Une rotation complète supposerait de déplacer la patiente, car, à la différence de sa position dans un scanner, elle se tient debout. Ce mouvement rendrait la reconstruction 3D beaucoup plus complexe. Et de manière générale, la récurrence des examens de dépistage implique de limiter la dose de rayons X à laquelle est soumis un individu. »

Par conséquent, les équipements actuels de tomosynthèse ne couvrent qu’un angle allant de 15 à 40° environ, bien loin des 360° du scanner. Cette limite détériore sensiblement la qualité de la reconstruction 3D réalisée à partir des images recueillies : du fait du manque d’informations, les éléments du sein visibles dans le volume reconstruit « s’étalent » et se mélangent aux structures environnantes. Ces dégradations, appelées « artéfacts », peuvent ainsi atténuer la visibilité des tumeurs au sein du volume 3D.

De faux seins pour entraîner le modèle d’IA à gommer les artéfacts

C’est pourquoi Arnaud, dans le cadre de sa thèse associant le Laboratoire Traitement et Communication de l’Information (LTCI) de Télécom Paris – école composante de l’institut Carnot TSN – et l’entreprise GE HealthCare, a cherché à développer une méthode pour réduire ces artéfacts. Son idée était alors d’utiliser un modèle d’intelligence artificielle, plus précisément de deep learning, qui apprendrait à détecter et à gommer les artéfacts présents sur les images de tomosynthèse du sein.

La première étape consistait à entraîner le réseau de neurones sur lequel repose l’algorithme de deep learning. Il fallait ainsi lui présenter une série d’images à comparer à une donnée de référence, à savoir une image de tomosynthèse ne présentant aucun artéfact. Problème : une telle ressource n’existe pas, à cause de la rotation limitée de tous les appareils existants – c’est d’ailleurs la raison d’être de la thèse.

Dès lors, comment alimenter l’algorithme d’IA dans sa phase d’apprentissage ? « Nous avons dû générer nous-mêmes des modèles synthétiques de seins, en nous appuyant sur des images provenant d’autres techniques de dépistage », révèle Arnaud. « Le scanner du sein, moins répandu que la tomosynthèse en raison d’un certain nombre d’inconvénients, permet de générer des images exemptes des artéfacts que nous cherchons à corriger. Nous avons alors utilisé ces images pour créer des modèles 3D de faux seins, en identifiant les tissus : graisse, glande mammaire, peau… » Un travail qui a nécessité une étape capitale d’adaptation, la qualité du scanner différant de celle de la tomosynthèse.

Mammographies virtuelles pour seins artificiels

Le chercheur a ainsi pu produire quelques centaines de modèles de seins artificiels. Un résultat probant mais insuffisant au regard de la quantité requise pour entraîner un réseau de neurones. Afin de pallier ce manque, Arnaud a procédé par « augmentation de données » : il a fait varier certains paramètres des images d’entraînement pour en obtenir de nouvelles et ainsi accroître leur nombre.

Ensuite, les seins artificiels ont passé un examen de mammographie… virtuel. Le chercheur a en effet simulé, par ordinateur, des acquisitions par un appareil de tomosynthèse à angle de rotation limité. Grâce à cette opération, le réseau de neurones disposait ainsi de tous les éléments nécessaires à son apprentissage : des images présentant des artéfacts, à comparer à des modèles de seins « parfaits ».

Une IA capable d’autoévaluer sa fiabilité

De cette façon, le modèle de deep learning a appris à reconnaître des artéfacts et à les faire disparaître. Dès lors, il était capable d’améliorer la qualité des images de tomosynthèse du sein. Mais dans quelle mesure peut-on faire confiance aux reconstructions qu’il produit ? « Il s’agit d’une question primordiale, à plus forte raison dans le domaine médical », confirme Arnaud. « Et pour y répondre, nous avons utilisé… le même modèle d’IA. En réalité, il ne se contente pas de reconstruire des images améliorées : il produit aussi une « carte d’incertitude ». Au sein de celle-ci, pour chaque pixel de l’image est calculé un niveau de doute, une valeur faible traduisant un degré élevé de certitude, et vice versa. » Un moyen de renseigner l’utilisateur quant à la fiabilité de l’information générée.

Mais comment l’IA peut-elle elle-même évaluer la pertinence de ses propres productions ? « Pendant la phase d’entraînement, le réseau de neurones apprend aussi que certaines zones du sein peuvent être plus ou moins difficiles à reconstruire », explique Arnaud. « Et nous pouvons l’aiguiller dans son apprentissage en confrontant la fiabilité qu’il a estimée avec son niveau d’erreur réel, c’est-à-dire l’écart mesuré entre l’image reconstruite et celle de référence. »

En définitive, pour chaque entrée, le modèle de deep learning livre deux sorties : une reconstruction de l’image du sein et une carte d’incertitude. Une double mission qui a nécessité un travail d’optimisation du réseau de neurones, étant donné que les deux tâches ainsi menées en parallèle peuvent empiéter l’une sur l’autre. Un défi d’équilibrage qui s’ajoutait à celui que constituait l’exploration d’un domaine – la reconstruction d’images de mammographie par IA – encore peu abordé dans la littérature scientifique, en raison de la faible quantité de données disponibles.

Le modèle de deep learning à l’épreuve des cas cliniques

Si le modèle développé présente des résultats satisfaisants sur un corpus de test composé d’images de synthèse, il reste de nombreuses étapes à franchir avant qu’il puisse être utilisé par des praticiens. Premièrement, il doit confirmer sa pertinence sur des images de meilleure qualité. En effet, jusqu’ici, il n’a été confronté qu’à des résolutions d’image inférieures à celles des appareils de tomosynthèse, en raison des contraintes de mémoire imposées par le matériel disponible lors de la thèse.

Surtout, une prochaine étape majeure consisterait à mettre le modèle de deep learning à l’épreuve de véritables images issues d’essais cliniques. Il s’agirait, dès lors, de démontrer que les résultats obtenus sur des données de synthèse sont également valables pour des cas réels de patientes. Ce qui constituerait alors un pas en avant significatif vers une meilleure détection du cancer du sein.